Avant toute chose, nous tenons à rappeler que ceci n’est pas un article à charge. Nous utilisons ces outils bien volontiers, et ne tenons pas à dissuader qui que ce soit de le faire, simplement à alerter quant aux pratiques habituelles de certains acteurs, qui ne sont en rien nouvelles ou inédites, mais qui correspondent à des schémas néfastes et se dissimulent davantage chaque jour, derrière des écrans de fumée tous plus opaques les uns que les autres.

L’Intelligence Artificielle (IA) est partout, révolutionnant nos vies et nos industries à une vitesse fulgurante. Des assistants vocaux aux voitures autonomes, en passant par les diagnostics médicaux, elle nous promet un futur plus intelligent et efficient. Mais derrière cette magie technologique se cache une réalité moins reluisante : une consommation énergétique gargantuesque, qui interpelle notre conscience écologique et met sous tension les infrastructures existantes.

Cette soif d’énergie, exacerbée par une course à la puissance et des modèles économiques compétitifs, soulève une question fondamentale : l’IA est-elle intrinsèquement insoutenable ? Ou existe-t-il des voies pour la rendre compatible avec un avenir plus respectueux de la planète ? Chez Lowforehead, artisans du numérique durable, nous pensons que la solution réside dans une approche plus réfléchie et une optimisation intelligente.

Prépare-toi, on va plonger au cœur des data centers et des algorithmes pour comprendre l’empreinte carbone de l’IA. Ensemble, nous explorerons comment des choix technologiques éclairés peuvent nous aider à construire une IA qui ne vide pas la batterie de notre bonne vieille Terre.

L’IA, une gloutonne énergétique à dompter

Tu l’as sûrement entendu : l’IA est gourmande. Très gourmande. Chaque interaction avec un modèle génératif, chaque apprentissage de nouvelles données, c’est une quantité d’électricité qui est dépensée. Ce n’est pas de la science-fiction, c’est la réalité de nos data centers qui chauffent à blanc et de nos processeurs graphiques (GPU) qui tournent à plein régime pour exécuter des calculs complexes à une échelle inimaginable.

Prenons l’exemple de l’entraînement d’un grand modèle de langage : cela peut engloutir l’équivalent de centaines de foyers pendant des mois. Et ce n’est que la pointe de l’iceberg ! L’article de Sciences et Avenir le souligne avec justesse : nous nous dirigeons vers une « consommation d’électricité insoutenable ». Le problème ne réside pas seulement dans le « machine learning » initial, mais aussi dans l’inférence, c’est-à-dire l’utilisation quotidienne de ces modèles par des milliards de personnes. Chaque requête à un ChatGPT ou un Claude IA a un coût énergétique, et ce coût s’accumule.

La course aux mégamodèles : un modèle économique vorace

Le souci, c’est que le marché de l’IA est dominé par une logique de « toujours plus grand, toujours plus puissant ». Les entreprises rivalisent pour développer des modèles avec toujours plus de paramètres, capables de prouesses toujours plus impressionnantes. Cette course à l’armement numérique est un cercle vicieux : plus un modèle est grand, plus il nécessite de puissance de calcul pour être entraîné et utilisé, plus il consomme d’énergie, et plus il faut d’infrastructures pour le faire tourner.

Ce modèle, basé sur une croissance exponentielle de la puissance brute, est aux antipodes de la philosophie de Lowforehead. Nous, on préfère la sobriété, l’optimisation et la durée de vie. Acheter du neuf sans discernement, jeter une machine encore fonctionnelle, c’est déjà une hérésie.

Imaginer une technologie qui épuise nos ressources énergétiques à cette vitesse, c’est un signal d’alarme qu’on ne peut ignorer.

Vers une IA plus sobre et durable ? Probablement pas…

Alors, doit-on renoncer à l’IA ? Sûrement pas ! Mais il est impératif de changer de cap. L’artisan numérique que nous sommes est convaincu qu’une autre voie est possible, axée sur la pertinence plutôt que sur la démesure.

La gravité de la situation n’ayant pas encore été clairement évoquée, nous prenons le parti de fournir aux lecteurs une réalité peu enchanteresse, mais cependant consistante :

Derrière le voile scintillant de l’innovation se cache une réalité moins glamour, voire carrément sombre. Une réalité où la soif de puissance de calcul se traduit par une consommation énergétique colossale et des impacts environnementaux tus, tout en bâtissant une économie opaque qui rappelle les bulles spéculatives les plus folles.

Chez Lowforehead Tech, nous ne sommes pas contre le progrès, loin de là. Mais notre ADN d’artisan numérique français, spécialisé dans la réparation hardware, les solutions web innovantes et la tech durable, nous pousse à regarder au-delà des discours marketing. Il est temps de décortiquer ce que les chiffres et les analyses indépendantes révèlent vraiment sur l’empreinte de l’IA. Préparez-vous, car ce que vous allez découvrir pourrait bien vous faire reconsidérer votre prochaine requête à ChatGPT, et même la nature de notre futur numérique.

Le Coût Caché de l’Intelligence Artificielle : Une Combustion Délibérée de Ressources

L’image d’une IA « immatérielle » est un écran de fumée. Chaque requête, chaque calcul, chaque modèle entraîné exige une puissance de feu numérique gargantuesque, et cette puissance se paie en électrons. La triste vérité, c’est que l’IA, dans sa forme actuelle, est une machine à brûler des ressources.

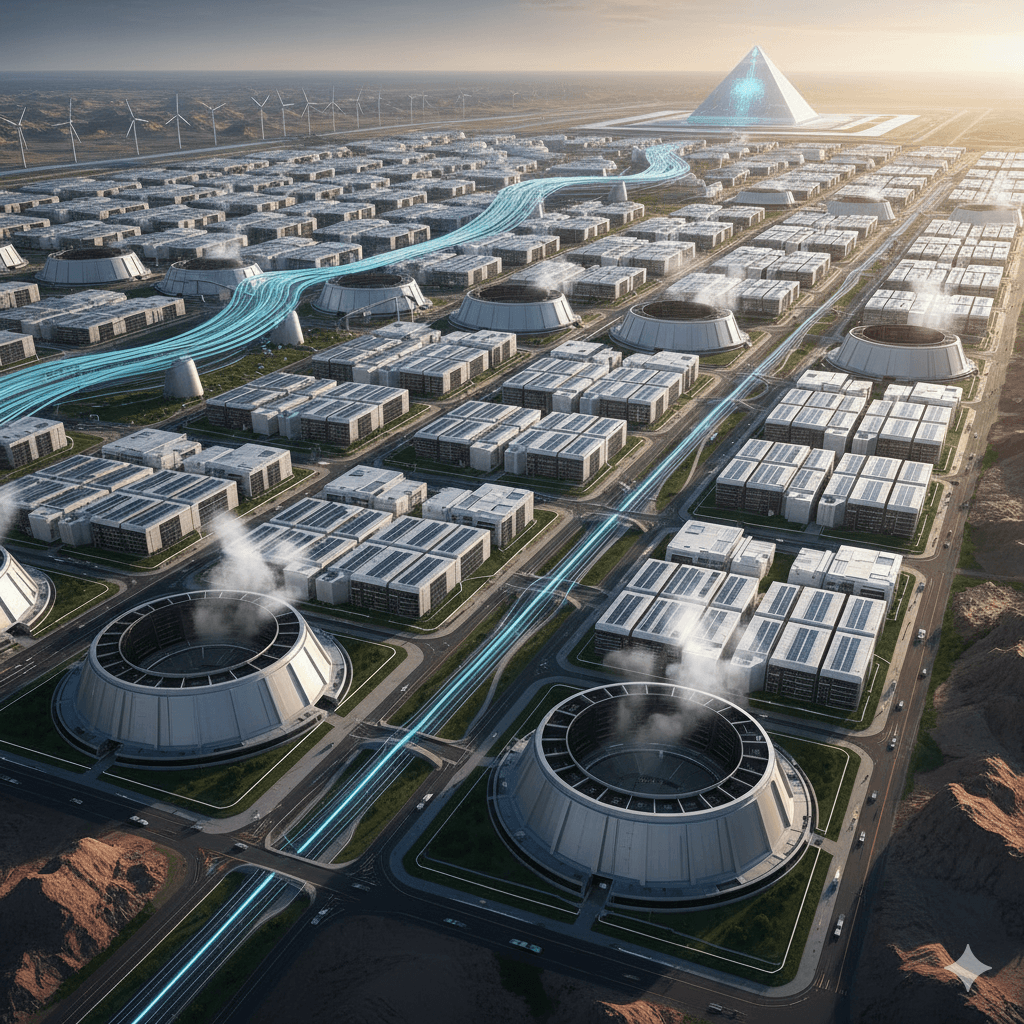

D’ici 2030, les data centers, véritables cathédrales modernes de la donnée, devraient engloutir près de 945 térawatt-heures d’énergie. Pour vous donner une idée, c’est une consommation qui dépasse celle de tout le Japon, un pays pourtant à la pointe de la technologie et densément peuplé. Et le plus troublant ? Selon le MIT News, 60% de cette énergie provient encore de combustibles fossiles, des sources d’énergie carbonées dont on nous enjoint, à juste titre, de nous détourner. On nous sermonne sur notre empreinte carbone individuelle, la consommation d’eau de notre douche ou de nos tomates en hiver, pendant que des infrastructures gigantesques tournent à plein régime sur du charbon pour entraîner des modèles d’IA dont l’utilité réelle pour l’humanité reste à prouver. C’est le fameux « deux poids, deux mesures » à l’échelle planétaire.

Cette course à l’armement technologique ne s’arrête pas à l’énergie. La fabrication des puces spécialisées (GPU) nécessaires à l’IA est également un processus gourmand en eau et en métaux rares, souvent extraits dans des conditions douteuses. Mais ces coûts environnementaux sont soigneusement dissimulés derrière le mantra de l’innovation inévitable.

L’Opacité, Alliée de la Consommation Excessive

Ce qui rend la situation encore plus insidieuse, c’est le manque de transparence. Les facteurs tels que l’emplacement du data center qui traite votre requête, la quantité exacte d’énergie consommée, et l’intensité carbone de cette énergie, sont des informations qui restent, la plupart du temps, confinées aux entreprises qui exploitent ces modèles. C’est ce que pointe le MIT Technology Review : une opacité totale pour un contrôle total.

Sans ces données, comment pouvons-nous, en tant qu’utilisateurs ou même décideurs, faire des choix éclairés ? Comment évaluer l’impact réel de l’IA sur notre planète si l’on nous cache les entrailles du processus ? C’est une stratégie bien rodée : plus c’est opaque, moins il y a de comptes à rendre.

L’Économie de Ponzi Technologique : La Fin Justifie-t-elle les Moyens ?

Au-delà de la consommation énergétique, il y a une dimension économique qui interpelle. Le secteur de l’IA, notamment générative, semble fonctionner sur un modèle qui rappelle dangereusement une économie de Ponzi. Des entreprises perdent 5 à 7 milliards de dollars par an en vendant leurs services à perte, tout en levant des fonds à des valorisations stratosphériques. Anthropic, par exemple, vise les 170 milliards de dollars, sans avoir encore prouvé une rentabilité pérenne. C’est une fuite en avant, où l’on brûle du cash en promettant des lendemains qui chantent, mais qui semblent toujours repoussés à « bientôt ».

Ce modèle n’est pas sans rappeler les bulles spéculatives qui ont émaillé l’histoire de la tech. Il ne s’agit pas simplement d’enrichir les riches, c’est bien plus pernicieux, comme le soulignent de nombreux experts.

Le Pattern Historique du Verrouillage de Marché

- Créer la dépendance : Habituer les entreprises et les particuliers à des outils IA à des prix défiant toute concurrence, voire gratuits. L’objectif est simple : devenir indispensable.

- Éliminer la concurrence : Seuls les mastodontes de la tech (backed par Microsoft, Google, Amazon) peuvent se permettre de perdre des milliards sur le long terme. Les startups innovantes mais moins capitalisées sont écrasées ou rachetées.

- Verrouiller le marché : Une fois les utilisateurs devenus dépendants et les alternatives éliminées, les prix peuvent être remontés à la guise des acteurs dominants.

- Contrôler l’infrastructure cognitive : Qui contrôle l’IA contrôle la manière dont les gens pensent, travaillent, créent. C’est le pouvoir ultime, celui de modeler la réalité numérique.

Ce n’est pas de l’incompétence, c’est une stratégie délibérée. Les factures d’électricité résidentielles en Virginie, par exemple, devraient plus que doubler d’ici 2039, principalement à cause de la croissance exponentielle des data centers (NPR). Les citoyens paient pour l’infrastructure et l’énergie, tandis que les géants de la tech récoltent les profits, ou du moins les valorisations futures. Bashir et Lee, cités par Smithsonian Magazine, soulignent que cette croissance n’est pas motivée par un besoin réel, mais par la spéculation. On construit une infrastructure énergivore et polluante sur un pari, pas sur une nécessité avérée.

Imposer une Vision, Redéfinir la Responsabilité

Le narratif est soigneusement orchestré : l’IA est présentée comme inévitable, une force de la nature à laquelle il faut s’adapter. Les coûts (environnementaux, sociaux, d’infrastructure) sont externalisés vers le public, tandis que les gains (financiers, de pouvoir) sont privatisés. La responsabilité de l’impact est ensuite renvoyée à l’individu : « utilisez l’IA de manière responsable », nous dit-on, alors que les rouages de cette machine sont volontairement opaques.

C’est une architecture de pouvoir qui se construit sous le couvert de l’innovation. En tant qu’artisans numériques chez Lowforehead Tech, nous pensons qu’il est crucial de ne pas être des moutons aveugles dans ce troupeau numérique. La durabilité, la transparence et l’éthique ne doivent pas être des options mais des impératifs.

💡 Astuce Lowforehead

Pensez à nos web-apps sur mesure qui minimisent la consommation de ressources tout en maximisant l’efficacité !

Et après ? Cultiver une Tech Durable et Maîtrisée

L’intelligence artificielle est un outil puissant, capable du meilleur comme du pire. Mais son développement actuel, opaque et gourmand en ressources, soulève des questions fondamentales sur notre avenir. Chez Lowforehead Tech, nous croyons qu’une autre voie est possible : une tech durable, locale et éthique. Nous développons des solutions web sur mesure, des outils de réparation pour prolonger la vie de vos appareils, et promouvons une consommation numérique raisonnée.

Ne laissons pas l’IA devenir un Moloch technologique qui nous dévore, nous et nos ressources. Interrogeons, exigeons la transparence, et soutenons les initiatives qui placent l’humain et la planète au cœur de l’innovation. Découvrez nos solutions et engagez-vous avec nous pour une tech plus responsable sur Lowforehead.tech.

Plutôt que de toujours vouloir le modèle le plus gigantesque, pourquoi ne pas se concentrer sur l’optimisation ?

- Algorithmes plus efficients : Des chercheurs travaillent sur des algorithmes d’IA moins gourmands, capables de réaliser les mêmes tâches avec moins de ressources.

- Hardware dédié et spécialisé : L’utilisation de puces spécifiquement conçues pour l’IA (comme les ASIC ou les FPGA) peut offrir une bien meilleure efficacité énergétique que des GPU généralistes, surtout pour l’inférence.

- IA locale et décentralisée : Pour certaines tâches, un modèle d’IA plus petit et spécialisé, exécuté localement sur ton appareil, peut être bien plus écologique que de faire appel à un data center lointain. C’est un peu le principe de « faire du neuf avec du vieux », mais appliqué aux calculs : utiliser la puissance de ta machine existante de manière intelligente.

- La frugalité numérique : Développer des modèles plus petits, plus ciblés, entraînés sur des datasets moins massifs mais plus pertinents, est une piste sérieuse. Moins de données à ingurgiter, c’est moins d’énergie.

Ces approches résonnent parfaitement avec notre engagement contre l’obsolescence programmée. Si on peut faire durer un PC vieux de 10 ans avec un système d’exploitation optimisé, on peut aussi développer des IA qui respectent les ressources limitées de notre planète.

Conclusion

L’IA représente une formidable opportunité, mais son développement actuel n’est pas sans impact sur notre environnement. La dépendance à une consommation énergétique exponentielle doit être remise en question, et ce, dès maintenant.

Chez Lowforehead, on croit fermement qu’il est possible de bâtir une technologie puissante et innovante, tout en restant ancré dans des valeurs de durabilité et de sobriété. L’avenir de l’IA passera par l’intelligence de ses développeurs à optimiser et celle de ses utilisateurs à choisir des solutions responsables.

N’oublie pas : chaque choix compte, de la réparation de ton smartphone grâce à nos astuces pour redonner vie à un smartphone à la sélection d’une IA plus éco-responsable.

Si tu as des questions sur l’optimisation de ton matériel ou si tu veux explorer des solutions web plus efficientes, n’hésite pas à nous en parler. Nous sommes là pour t’accompagner vers une tech qui a du sens, à échelle humaine. Viens nous poser tes questions directement sur notre Chat Lowforehead, on est là pour ça !

Laisser un commentaire